人工知能(AI)は今やいたるところに存在していると言っても大げさではない。最近では、AIの新しい姿やアプリケーションを目にしない日はない。映像制作の世界ほどそれが当てはまるところはないだろう。

プリプロダクションでの脚本執筆やロケハンから、ポストプロダクションでのオブジェクト除去やシーンの安定化まで、AIと機械学習(ML)による買収は現実のものとなっている。退屈な作業に費やす時間が減るということは、M&Eプロが経費を節約し、貴重な時間をより価値のある仕事に費やせるということだ。

しかし、おそらく最も革新的で強力な方法のひとつは、このような「力」を活用することだろう。 AIが映像の世界に革命を起こす を通してである。 ビデオ理解.

この投稿は トゥエルブ・ラボ映像理解のためのマルチモーダルAIのパイオニアである。 ブログで紹介されました.

目次

膨大なデータセットのファイル転送

大規模なデータセットや大容量の動画ファイルをAI処理用にクラウドにオフロードするための、最も高速で簡単な方法です。

ビデオ理解とは?

ビデオ理解 モデルはビデオコンテンツを分析、解釈、理解し、ビデオの文脈全体を理解できるように情報を抽出する。

フレームごとにオブジェクトを識別したり、オーディオコンポーネントを解析したりするだけではない。 AIを活用した映像理解で、自然言語と映像内の動作を対応付ける.そのためには、アクティビティ認識や物体検出など、さまざまな映像理解タスクを実行し、映像の視覚、音声、スピーチの要素を処理・理解することで、この最も流動的なメディアを通じて伝えられていることのニュアンスを把握しなければならない。

また、ChatGPTのような大規模言語モデル(LLM)とは異なり、ビデオデータを理解するために特別に訓練されているわけではない。

簡単に言えば、AIのビデオ理解モデルは、私たちと同じようにビデオを理解する。

これは大きな挑戦だが、ビデオ理解インフラ企業であるTwelve Labsは熱心に取り組んでいる。

メディアとエンターテインメントにおける映像理解の応用

ディープ・ビデオ理解の背後にあるテクノロジーに飛び込む前に、ビデオ理解がM&Eプロやビデオ・コンテンツ・クリエーターの仕事をどのように効率化できるかを正確に探ってみよう。

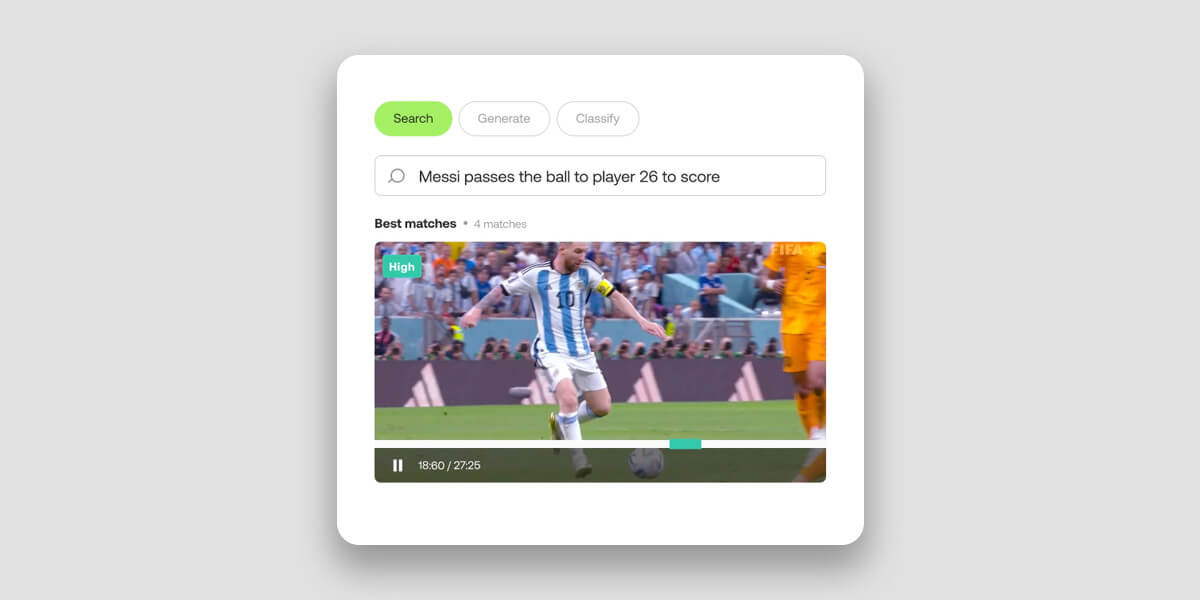

ビデオ検索

ペタバイトの膨大なデータ・コレクションから、そのビジュアル要素を自然言語で説明するだけで、特定のビデオを見つけられることを想像してみてほしい。あるいは スポーツリーグまたはクラブAIビデオ理解モデルに次のように依頼する。 選手の全ゴールを数秒でハイライトリールに組み立てる.

これらはすべて、AIの映像理解によって可能になる。

一方、従来の動画検索は、そのアプローチと実行に大きな限界がある。動画のインデックス化と検索を主にキーワードマッチングに頼ることで、視覚的・聴覚的な手がかりを通じて動画をより深く理解するマルチモーダルAI技術を活用していないのだ。

画像、音声、スピーチ、画面上のテキストなど、利用可能なすべてのデータタイプを同時に統合することで、最新の映像理解モデルが実現します。 これらの要素間の複雑な関係を捉え、よりニュアンスのある人間らしい解釈を提供する。.

その結果、クラウド・オブジェクト・ストレージからのビデオ検索と取得が、はるかに速く、はるかに正確になります。ビデオ編集者は、時間のかかる非効率的な手作業によるタグ付けの代わりに、自然言語を使用して膨大なメディア アーカイブを迅速かつ正確に検索し、他の方法では気付かれないかもしれないビデオ モーメントや隠れた逸品を発掘することができます。

トゥエルブ・ラボの 検索API 1時間のビデオをインデックス化するのに約15分かかり、インデックス化されたビデオは100以上の言語で意味的に検索可能になる。

ビデオ分類

AIを活用したビデオ理解により、ビデオを事前に定義されたクラスやトピックに自動的に分類することができます。Twelve Labsの APIを分類するビデオをスポーツ、ニュース、エンターテイメント、ドキュメンタリーに分類することができます。

このモデルはまた 特定のシーンを分類するこの技術は、広告やコンテンツモデレーションに関連する実用的なアプリケーションに力を発揮する。この技術は、例えば武器を含むシーンを、文脈に基づいて教育的、ドラマチック、暴力的と識別することができる。

これは、ユーザーの興味や嗜好に基づき、より正確なレコメンデーションを提供することで、ユーザーエクスペリエンスを向上させるとともに、クリエイターやビデオプラットフォームに利益をもたらす。また、編集、アーカイブ、その他の目的のためにアイテムを素早く見つけて記録する必要があるポストプロダクションのプロにもメリットがある。

Twelve Labsのテクノロジーで使用されているすべてのビデオには、以下のものが含まれている。 標準メタデータを追加するオプションもある。 カスタムメタデータ をビデオに追加することで、より詳細な、あるいは文脈に特化した情報を提供することができる。

監視やセキュリティーからスポーツ分析まで、またコンテンツの調整から文脈に応じた広告まで、ビデオ理解はビデオの分類を完全に覆す能力を持っている。

ビデオの説明

Video Understandingは、数秒で生成される詳細な説明によって、動画データセットを自動的に要約することができる。このテクノロジーは、長い動画を最も重要なコンテンツを捉えた簡潔な表現に凝縮することで、理解度とエンゲージメントを向上させます。

このような迅速で詳細な要約は、説明的なメタデータや要約でメディアを充実させる際に大きな助けとなる。特に、身体障害や認知障害を持つ人々の間では、ビデオは理想的なメディアではない。

メディアおよびエンターテイメント業界では、動画の説明や要約は、映画、テレビ番組、その他の動画コンテンツのプレビューや予告編を作成するために使用できます。これらのプレビューは、コンテンツの簡潔な概要を提供し、視聴者が動画本編を見るかどうかを判断するのに役立ちます。また、ユーザー体験を向上させるものは何でも良いことだ。

トゥエルブ・ラボの APIスイートの生成 は、あなたのビデオに基づいてテキストを生成します。様々な要件を満たすために調整された3つの異なるエンドポイントを提供しています。各エンドポイントは、さまざまなニーズに対応するために、特定のレベルの柔軟性とカスタマイズ性を持って設計されています。

映像理解を支えるテクノロジー

「AIは世界中のデータの80%を理解することができません。なぜなら、AIは動画コンテンツに閉じ込められているからです」とトゥエルブ・ラボのCEOは説明する。 ジェ・リー MASVのインタビューで。"我々はそれを解く鍵を作るのだ"

実際、デジタル画像を理解するためにニューラルネットワークやMLを使用する従来のコンピュータビジョン(CV)モデルは、ビデオ内のコンテキストを理解するのが常に困難だった。CVモデルは、オブジェクトや動作を識別することには長けているが、それらの間の関係を識別することはできない。このギャップが、最近までAIを使ってビデオコンテンツを正確に分析する能力を制限していた。

トラビス・クートゥアTwelve Labsの創業者であるソリューション・アーキテクトは、この問題をコンテンツ対コンテクストの構図に当てはめた。

「従来のアプローチは、ビデオコンテンツを解決しやすい問題に分解することでした。それは通常、個々の画像としてフレームごとに分析し、オーディオチャンネルを個別に分割して、それらのトランスクリプションを行うことを意味します。この2つのプロセスが終わると、すべてを一緒にして、発見を組み合わせます。

壊して作り直す」。コンテンツはあってもコンテキストがない.そしてビデオでは、文脈が王様だ。

「トゥエルブ・ラボの目標は、従来のコンピューター・ビジョンのアプローチから、ビデオ理解の分野に移行することです。

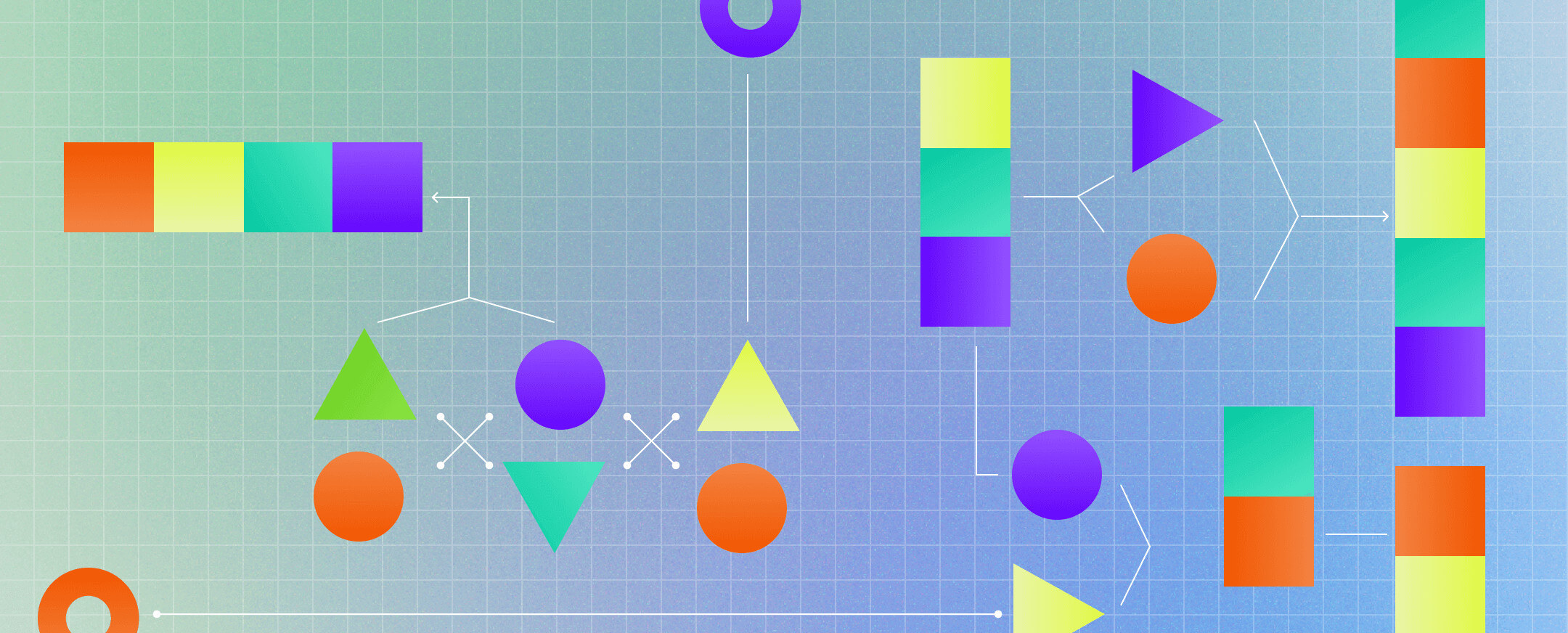

マルチモーダル映像理解

出典元: マルチモーダルAIとは何か?

ビデオはダイナミックで、層状で、流動的なものであり、要素を分解して個別に分析すると、全体としてまとまらない組み合わせである。トゥエルブ・ラボはこの問題を解決した。しかし、どのように解決したのだろうか?

雇用することによって マルチモーダルAI.

この文脈での "モダリティ "とは、ある出来事を経験する方法を指す。現実世界と同様、ビデオにも複数のモダリティが存在する:聴覚、視覚、時間、言語、その他。

「これらのモダリティを個別に分析し、それらをつなぎ合わせようとするとき」とTwelve Labsの共同設立者兼事業開発責任者は説明する。 イ・ソヨン全人格的な理解とコンテクストを達成することはできない」。

トゥエルブ・ラボのマルチモーダル・アプローチは、人間がビデオを解釈する方法を再現するモデルを構築することを可能にした。「我々の マレンゴ ビデオ・ファンデーション・モデルは、知覚的、意味的、文脈的な情報を次のような形で提供する。 ペガサス私たちの生成モデルは、人間が知覚から処理、論理に至る方法を模倣しています」とクチュールは説明する。

人間の脳が常に膨大な量の情報を受信し、解釈し、整理しているように、Twelve LabsのマルチモーダルAIは、複数の刺激を首尾一貫した理解に合成することを目的としている。時間、物体、音声、テキスト、人物、行動などの変数に関するデータをビデオから抽出し、データをベクトル(数学的表現)に合成する。

これを実現するために、行動認識や行動検出、パターン認識、物体検出、シーン理解などのタスクを採用している。

総合的な映像理解のアプリケーションは、M&Eだけでなく、それ以外の分野でも非常に広範囲に及ぶため、Twelve Labsは、以下のようなサンドボックス環境を提供しています。 遊び場-同社は、ユーザーがビデオ理解技術を探求し、テストすることを可能にする。同社はまた ドキュメンテーション そして、ユーザーがわずか数回のAPIコールでビデオ理解機能をプラットフォームに埋め込むことができる堅牢なAPIを提供している。

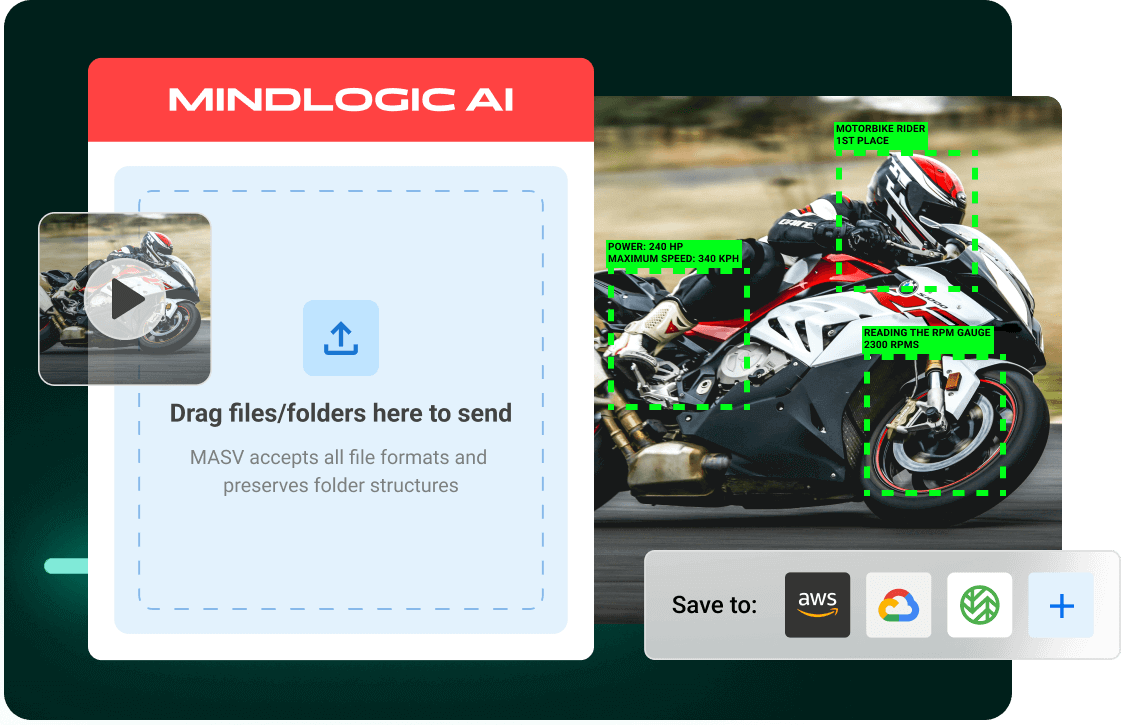

MASVとTwelve LabsがクラウドでAIビデオワークフローを実現

2023年12月現在 3億2877万テラバイト 毎日、世界中のデータが作成されている。 そのうち53.27パーセントがビデオ-と上昇している。Twelve Labsのビデオ理解技術が重要なのは、このようなビデオへの劇的かつ継続的なシフトがあるからです。

MASVはまた、すでに計り知れない成長を遂げているビデオの可能性を理解しています。私たちの摩擦のない高速な大容量ファイル転送サービスは、膨大なデータセットをAI処理のために一般的なクラウド環境に取り込むことができます。 Amazon S3自動化された安全なファイル・アップローダーを使用しています。これにより、コンテンツの取り込みが簡素化され 動画を含むAIワークフロー などの大規模データセットがある。

ユーザーは、転送されたファイルをユーザーのS3インスタンスに自動的にアップロードするようにMASVを設定し、Twelve Labsを使用して、アーカイブ/コンテンツ検索やビデオ要約などのAIビデオ理解タスクを迅速化することができます。

MASVとTwelve Labsを試してみませんか? MASVに登録する 今なら20GBの無料データ容量がもらえます。 トゥエルブ・ラボの遊び場 ビデオ理解の力で何ができるかを探求する環境を提供します。

ビッグデータをクラウドに取り込む

MASVは、ビデオトレーニングデータセットをこれまで以上に迅速にクラウドに移行し、AIワークフローを開始します。